据404 Media报道,达特茅斯学院政府学副教授、极化研究实验室负责人肖恩·韦斯特伍德近期于《美国国家科学院院刊》(PNAS)发表的一项新研究表明,在线调查研究作为众多科学研究里数据收集的基本方式,正遭受大语言模型带来的严峻威胁。

韦斯特伍德研发出一款叫做“自主合成应答者”的AI工具,该工具不仅可以回答调查问题,还展现出近乎完美绕过当下最先进机器人检测手段的能力。

论文指出,这款 AI 智能体成功避开检测的概率高达 99.8%。韦斯特伍德在新闻稿中表示:“我们再也不能确信调查的答复来自真正的人类了。机器人污染的数据可能会破坏整个知识体系。”

这款 AI 智能体还成功规避了“反向禁忌”问题。“反向禁忌”通过设计任务来识别非人类行为者,大模型能轻松完成这些任务,人类则几乎不可能完成。

论文《大语言模型对在线调查研究的潜在生存威胁》指出:一旦推理引擎选定了回答,第一层就会执行专注于模仿人类的相应行动。为了躲避自动化检测,其模拟了与该个体教育水平相符的阅读时间,生成类似人类的鼠标移动,逐字输入开放式问题的答案,并包括合理的打字错误和更正。该系统还设计了 reCAPTCHA 等绕过反机器人措施的工具,而这通常是自动化系统的一个障碍。

论文还表示,AI 可以模拟“完整的人口统计特征”,意味着理论上任何人都可以通过生成特定人口特征的 AI 干预,操控在线调查的结果,而且甚至仅仅几个虚假回答就足以影响调查的结果。

论文提到,在 2024 年大选前的七大主要民意调查中,仅需加入 10 到 52 个虚假 AI 回答,就足以改变预测结果。这些虚假回答的生成成本非常低,每个仅需五美分,而人类受访者通常获得 1.50 美元(注:现汇率约合 10.7 元人民币)的酬劳。

论文使用 OpenAI 的 o4-mini 进行测试,也使用了 DeepSeek R1、Mistral Large、Claude 3.7 Sonnet、Grok3、Gemini 2.5 Preview 等其他模型,证明该方法适用于不同的大模型。该智能体通过接收约 500 字的提示,了解要模仿的个性,并按人类的方式回答问题。

论文指出,研究人员可以通过多种方式应对 AI 智能体污染调查数据的威胁,但每种方式都有权衡。例如,研究人员可以对调查参与者进行更多的身份验证,但随之而来的就是隐私问题。论文还建议,研究人员应更加透明地说明调查数据的收集方式,并考虑采用更受控的参与者招募方法,如基于地址的抽样或选民文件。

论文得出结论,要保证民意调查与社会科学研究始终保持有效性,就必须探索并创新出能够应对AI时代快速发展所带来挑战的研究设计。

九年同行不负热爱!《碧蓝航线》喜迎九周年华诞 双向奔赴共赴新程

高度还原!《鸣潮》×《赛博朋克:边缘行者》丽贝卡战斗演示PV震撼发布

PS顽皮狗实力超群!《神海4》和《007》全面比拼 丝毫不落下风

6月港服PS+会免游戏上线啦!微软第一方佳作成为本次阵容主角

苹果首款折叠屏手机外观首度曝光!价格突破纪录 即将投入量产

索尼PS第一方游戏销量四年下滑3000万份 服务型战略被批未达预期

索尼发布会即将揭晓重磅作品!知情人士承诺:定会带来惊喜

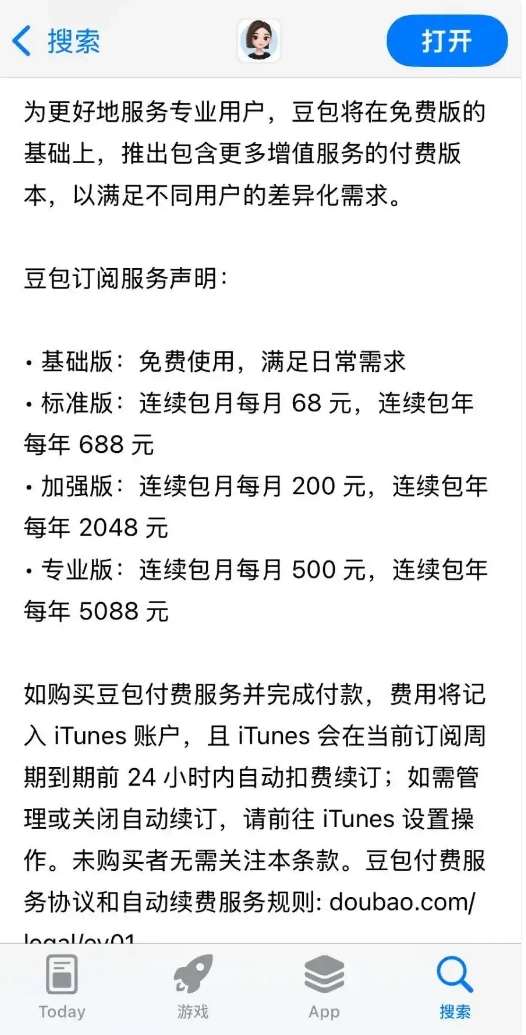

热搜爆了!豆包三档付费订阅规则争议不断,网友们争论不休

能干的后辈葵酱游戏

2026-06-03 18:39:39更新

樱花校园(无广告版)

2026-06-03 18:10:19更新

口袋妖怪刽曜之影

2026-06-03 17:23:10更新

诱拐城镇

2026-06-03 17:18:37更新

易查车

2026-06-03 17:03:21更新

手机电子秤

2026-06-03 16:57:20更新

冲鸭fm正版

2026-06-03 16:55:55更新

健康大兴

2026-06-03 16:37:47更新

太公传承

2026-06-03 16:34:17更新

玲珑视频最新版

2026-06-03 16:21:15更新